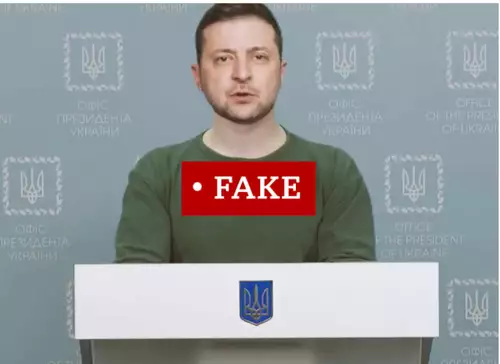

Es hat eigentlich erstaunlich lange gedauert, aber vorgestern war es soweit: der erste, in einer großen weltpolitischen Krise gezielt instrumentell eingesetzte DeepFake ist produziert worden. Ein gefälschtes Video, in welchem der ukrainische Präsident Volodymyr Zelensky sein Volk zur Kapitulation aufruft, erschien auf der offiziellen, aber gehackten ukrainischen Nachrichtenseite "Ukraine 24" zusammen mit einem gleichlautenden Ticker-Text. Vorausgesagt war dieser spezifische Versuch, den ukrainischen Widerstand per psychologischer Kriegsführung zu schwächen, schon seit Wochen, jetzt hat eine - vermutlich der russischen Regierung nahestehende - Hackergruppe das ganze in Szene gesetzt.

Erstaunlicherweise ist das Video für seine propagandistische Wichtigkeit kein sehr gut gemachter DeepFake. Das Gesicht ist zwar recht überzeugend, aber der Kopf bewegt sich nicht im Einklang mit dem Körper, die Auflösung ist gering, die Stimme klingt mechanisch und der Akzent ist falsch. Das Video wurde trotzdem mehrere 100.000 Mal angeschaut und online geteilt, es macht seine Runden und sät Zweifel (an der Authentizität echter Zelensky Videos).

Allerdings reagierte die ukrainische Regierung schnell und Zelensky persönlich machte per Video klar, dass es sich bei der Kapitulationserklärung um eine Fälschung handelte - der Fake-Clip wurde dann schnell auf allen großen Plattformen wie Facebook und YouTube gelöscht. In diesem Fall wurde der DeepFake also ziemlich schnell als solcher erkannt.

Zur Erkennung besser gemachter Fakes gibt es auch eigene Deep Learning Algorithmen zur Erkennung von DeepFakes. Klar ist: um wirklich durchschlagend zu wirken, muss ein DeepFake sowohl gut gemacht, als auch glaubwürdig sein, über vertrauenswürdige Kanäle verbreitet werden und dem Original die Möglichkeit genommen werden, schnell glaubhaft öffentlich zu widersprechen.

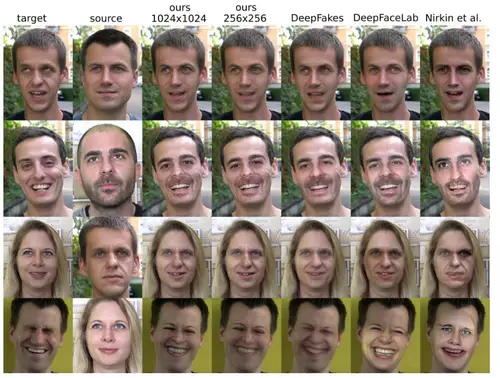

Aber da die DeepFake Technologie immer besser und immer weniger Vorwissens bedarf, werden wahrscheinlich noch viele DeepFakes von mehr oder weniger Prominenten, aber auch Privatpersonen auftauchen, in die Welt gesetzt von Ex-Partnern, Konkurrenten, fehlgeleiteten Fans oder wem und aus welchen Gründen auch immer. Interessant ist es, sich zu erinnern, in welchem Zusammenhang DeepFakes zuallererst vor rund 4 Jahren die Bühne betreten haben: in Pornos wurden die Gesichter der Darstellerinnen durch die bekannter Schauspielerinnen ausgetauscht.

Hier der sehr bekannte und gut gemachte Tom Cruise DeepFake:

Was sind DeepFakes?

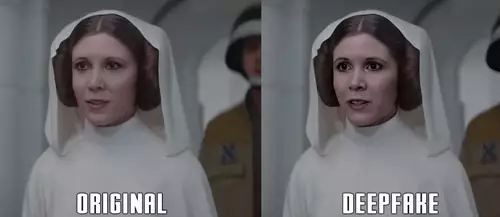

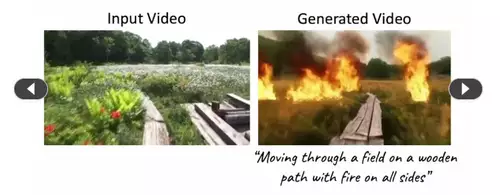

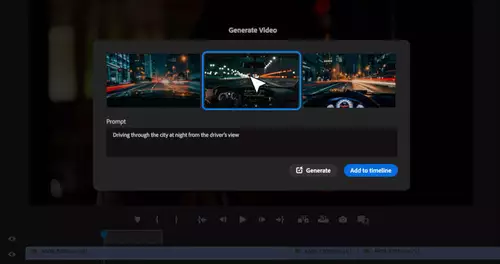

DeepFakes - ein Konglomerat aus Deep Learning und Fake - nutzen Deep Learning Technologien, welche anhand von Beispielmaterial vieler Gesichter trainiert werden, um dann in einem Video ein Gesicht gegen ein anderes auszutauschen. Das ausgetauschte Gesicht vollzieht dann die Mundbewegungen und die Mimik des ursprünglichen Gesichts, das dann wie ein Puppenspieler agiert, nach, aber mit seinen (per Training gelernten) speziellen Eigenarten. Im Falle von Zelensky stand auf jeden Fall genügend Material von Reden von Zelensky zur Verfügung, um den DeepFake-Learning Algorithmus zu trainieren.

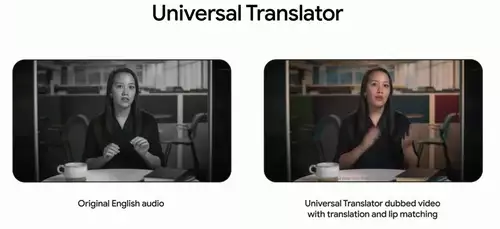

Das ganze kann dann noch ergänzt werden durch eine ebenfalls per Deep Learning erfolgte Simulation der Stimme der ausgetauschten Person, dann können relativ einfach jedem Menschen beliebige Worte in den Mund gelegt werden, die (je nach verwendeter Technik, Sachverstand der Faker und Trainingsmaterial) täuschend echt aussehen. Schon seit den Anfängen der DeepFake-Technologie wird deshalb gewarnt, daß die Technik auch für politische Täuschungsmanöver eingesetzt werden könnte.

Inzwischen kann jedermann sich das entsprechende Fachwissen leicht aneignen und mittels etwas Quellvideomaterial des einzutauschenden Gesichts solche Fälschungen erzeugen. Auch Filmstudios wie Disney setzen auf DeepFake-Technologie, um zum Beispiel tote Schauspieler (wie etwa Prinzessin Leia in zukünftigen Star Wars Folgen) wieder filmisch möglichst lebensecht zum Leben zu erwecken.