Die KI-Entwicklung schläft nicht - während wir noch dabei sind, für die Newsstrecke diverse neue Video-Tools aufzuarbeiten, die während der NAB vorgestellt wurden, möchten wir euch ein paar Clips zeigen, die recht unterhaltsam den aktuellen Stand in Sachen generativer Video-KI demonstrieren. Sie entstanden ua. mit Runway Gen2 und weisen noch immer die KI-typischen Schwächen auf wie z.B. Phantomgliedmaßen, waren dafür jedoch in kurzer Zeit und für wenig Geld produziert:

Der Trailer für "The great Catspy" besteht aus ca. 65 kurzen Einzelclips, die mit Runway Gen-2 über Textprompts (!) erstellt wurden und untereinander eine erstaunliche Konsistenz aufweisen. Es wurden jedoch weitaus mehr Clips generiert, über 500 - viele wurden wieder verworfen, bei manchen nochmal nachgebessert. Bei der Auswahl der Shots und der Montage in Premiere Pro orientierte sich der Filmemacher - Visiblemaker - an der Musik. Die Stimmen wurden mit Eleven Labs synthetisiert, beim Skript half ChatGPT. Die SoundFX wurden wie es scheint per menschlicher Hand hinzugefügt. Die Filmerstellung soll nur zwei Tage gedauert haben - ganz ohne Kamera oder Animation.

Bis auf den Zusammenschnitt bzw. den Übergängen der verschiedenen Sequenzen und die Typografik wurde alles in diesem Werbespot für den fiktiven Pizza-Dienst "Pepperoni Hug Spot" von KI-Tools generiert. Der Inhalt und der Text (samt des catchy Titels) stammt aus der virtuellen Feder das Sprachmodells GPT4, die Bildvorlagen erstellte basierend auf dessen Prompts Midjourney, woraufhin sie in Runway Gen2 in Bewegtbild umgewandelt wurden. Für die künstliche Stimme des Voice-Over wurde auch hier Eleven Labs genutzt, die Musik kommt von SOUNDRAW AI Music, ein Dienst, mit welchem sich Hintergrundmusik per KI generieren läßt.

Die deformierten Gesichter der Pizza-Essenden lassen - wie schon bei The Great Catspy - zwar keinen Zweifel an ihrer KI-generierten Herkunft und der Text liegt immer leicht daneben, doch entsteht so sogar ein besonderer Charm. Und "It´s like family, but with more cheese" ist tatsächlich ein verdammt guter Werbe-Claim - auf allgemeinen Wunsch bietet der Macher des Clips bereits T-Shirts mit dem Spruch an.

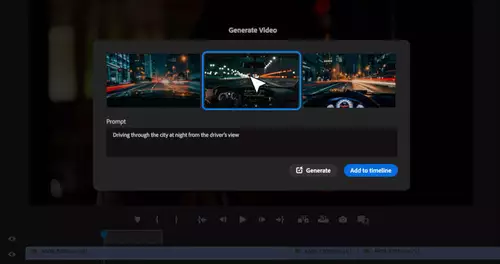

Man sieht also sehr gut, was mit den aktuellen Tools bereits möglich ist - keine perfekten, photorealistischen Resultate, aber durchaus "originelle" Videos. Durch den Kniff des schlechten VHS-Looks fallen die Fehler in diesem Fall auch weniger auf, etwa wenn statt an der Pizza, die manchmal wie ein Riesen-Bruschetta aussieht, am Teller geknabbert wird. Wenn die generativen Bild- bzw. Video-KIs erstmal über eine native Integration mit GPT4 verfügen, dürfte es auch nicht mal mehr nötig sein, Typo-Elemente händisch einzufügen; noch sind die Bild-KIs allerdings sehr unbeholfen, sobald es um Schrift geht. Auch die Montage einzelner Videoschnipsel anhand einer - von GPT4 automatisch erstellten - Schnittliste dürfte in absehbarer Zeit auf Knopfdruck erfolgen können.

Wieviele verschiedene Versionen der Texte, Bilder und Videos jeweils erstellt und ggf. verworfen wurden, um zum finalen Ergebnis zu kommen, wäre allerdings noch die Frage - und wird es wohl auf längere Sicht noch bleiben. Als Human-in-the-Loop wird uns vielleicht just diese Aufgabe zukommen, wenn zusammen mit KI-Systemen produziert wird: die der Auswahl der verschiedenen Elemente.

Zur Entstehung des dritten Videos ( Quelle: Uncanny Harry auf Twitter) ist nicht sehr viel bekannt, außer dass es ebenfalls mit der generativen Video-KI Runway Gen2 entstand (die noch immer in einer geschlossenen Beta ist). Ob hier nur Text-Prompts verwendet wurden oder auch Bilder, ist also unklar.

Wer nun meint, der Clip sehe einfach nur nach Videospiel aus, bedenke, dass für solche Bilder bisher sehr aufwendige Game-Engines benötigt wurden. Wie realistisch es Runway (oder anderen generativen Videos-KIs) in Zukunft gelingen wird, Menschen darzustellen, bleibt abzuwarten; wir machen uns auf alles gefaßt.

Auch der Song im Hintergrund ist übrigens mit KI-Tools entstanden, allerdings was die Stimme des Sängers betrifft: zu hören ist nämlich ein Fake-Kanye West. Seine Stimme wurde einfach synthetisiert und eingefügt anstelle des ursprünglich Eingesungenen.