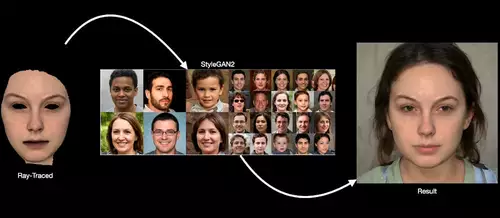

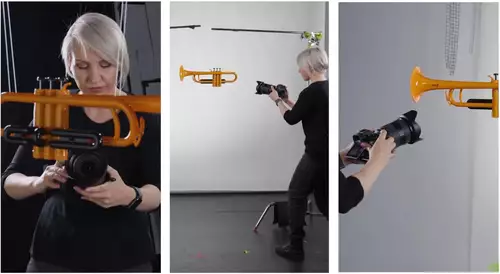

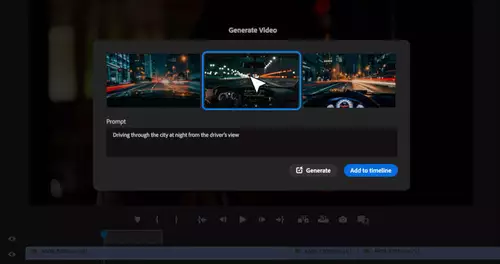

Nvidia hat mit Omniverse Audio2Face ein kostenloses Programm vorgestellt, mit dessen Hilfe sich 3D-Gesichtsmodelle einfach nur durch Sprachinput - auch in Echtzeit - animieren lassen. Omniverse Audio2Face beta ermöglicht die Animation eines 3D-Charakters mittels jeder beliebigen Sprachaufnahme, egal ob der Charakter für ein Spiel, einen Film, einen digitalen Echtzeit-Assistenten oder einfach nur zum Spaß animiert werden soll. Seine Besonderheit ist, daß es das Gesicht nicht nur lippensynchron zur Sprachaufnahme animiert, sondern daß es passend zum Tonfall und Inhalt der gesprochenen Worte auch noch die entsprechenden Gefühle per Mimik unterstreicht.

Das Tool versteht eine ganze Reihe von unterschiedlichen Sprachen und kann für interaktive Echtzeitanwendungen live per Mikrophon oder als traditionelles Tool zur Erstellung von Gesichtsanimationen mittels Sprachaufnahmen verwendet werden. Audio2Face ist mit "Digital Mark" vorinstalliert - einem 3D-Charaktermodell, das für einen einfachen Einstieg einfach per eigenem Audio animiert werden kann. Es können natürlich auch eigene Modelle (zum Beispiel von Epic Games Unreal Engine 4 Meta-Human) importiert und genutzt werden. Der Audio-Input wird dann in ein vortrainiertes Deep Neural Network eingespeist, die Ausgabe steuert dann die 3D-Eckpunkte des Charaktermeshs, um die Gesichtsanimation in Echtzeit zu erstellen. Mittels verschiedener Nachbearbeitungsparameter kann die Performance des Charakters optimiert werden.

Animation mehrerer Gesichter

Per Audio2Face können sowohl menschliche als auch menschenähnliche 3D-Gesichter, egal ob realistisch oder stilisiert, animiert werden. Mittels mehrerer Instanzen von Audio2Face ist es auch möglich, mehrere verschiedene Charaktere in einer Szene zu animieren - alle animiert von derselben oder von verschiedenen Audiospuren. So können zum Beispiel auch Dialoge zwischen einem Duo, ein Sing-Off zwischen einem Trio, ein synchrones Quartett und vieles mehr zum Leben erweckt werden. Die Mimik der einzelnen Gesichter kann gezielt verstärkt oder auch abgeschwächt werden

Gezieltes Steuern von Gefühlsäußerungen

Audio2Face bietet die Möglichkeit, spezielle Emotionen (wie etwa Wut, Angst, Trauer oder Erregung) für ein Gesicht auszuwählen und deren Ausdruck zu steuern. Die KI animiert dann automatisch passend das Gesicht, die Augen, den Mund, die Zunge und die Kopfbewegung, um die gewählte emotionale Bandbreite und den gewählten Grad an Intensität zu erreichen.

Systemvoraussetzungen

Systemvoraussetzung ist Windows 10 64-Bit, mindestens eine Intel i7 oder AMD Ryzen CPU mit 4 Kernen und 2.5 GHz, 16 GB RAM, eine 500 GB SSD sowie (natürlich) eine Nvidia RTX GPU mit mindestens 6 GB VRAM. Omniverse Audio2Face beta, das auf einer schon 2017 erschienenen Studie von Nvidia beruht, kann hier kostenlos heruntergeladen werden.