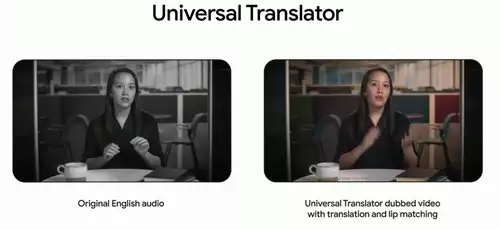

Google hat auf seiner Entwicklerkonferenz unter anderem den - noch experimentellen - "Universal Translator" vorgestellt, einen digitalen Übersetzer, der gleiche mehrere KI-Funktionen in sich vereint. Er kann gesprochene Worte in Videos nicht nur in eine andere Sprache übersetzen, sondern diese quasi per DeepFake der sprechenden Person auch wieder in den Mund legen - in ihrer eigenen Stimme und mit entsprechend angepassten Lippenbewegungen.

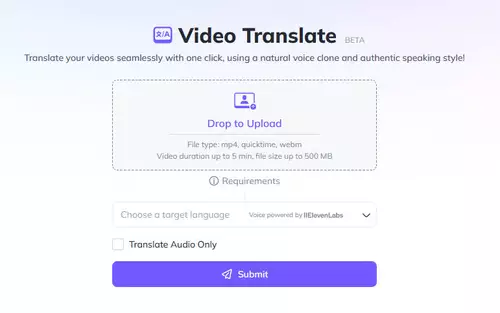

Im professionellen Filmbereich gibt es seit einiger Zeit Dienste wie Flawless AI, welche visuelles Dubbing für Kinofilme anbieten und dabei per KI die Lippenbewegungen eines Schauspielers an den vom Synchronsprecher gesprochenen Text anpassen. Googles "Universal Translator" ergänzt dies also noch um die automatische Übersetzung samt Klonen der Originalstimme mit dem jeweiligen Tonfall, wie es zum Beispiel Eleven Labs auch beherrscht.

Google zielt mit seinem Universalübersetzer nicht aufs Kino, sondern YouTube-Videos. Demonstriert wurde der neue Algorithmus deswegen auch anhand einer Vorlesung aus einem Online-Kurs, den Google zusammen mit der Universität von Arizona ursprünglich auf Englisch produziert hat. Dank einer automatischen Übersetzung in YouTube könnte in Zukunft solche Kurse in jeder beliebigen Sprache angeboten werden und so für ein viel breiteres Publikum verfügbar sein.

Viele KI-Techniken in einem Tool

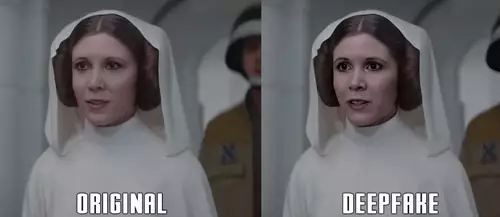

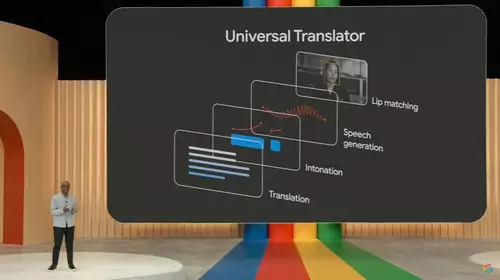

Googles "Universal Translator" nutzt gleich mehrere schon vorhandene Techniken, um seine Aufgabe zu erledigen. Zuerst wird das gesprochene Wort in Text transkribiert und die Stimme des Sprechers samt der Intonation analysiert. Dann wird dieser Text in die gewünschte Sprache übersetzt und in der Stimme des Sprechers neu synthetisiert. Zuletzt werden die zum neuen Audio passenden Lippenbewegungen generiert und mit dem Gesicht der sprechenden Person fusioniert.

Hier die Vorstellung: des Universal Translators (1:14:29):

Die Gefahren

Neben den vielen praktischen Einsatzzwecken hat eine solche Technologie auch ein großes Potential zum Missbrauch. Google ist sich aber durchaus der Gefahren solcher automatisierter Technologien bewusst, deswegen haben im Zuge des Dogmas "Bold and responsible AI" vorerst nur autorisierte Partner Zugriff auf den "Universal Translator", der sich ohnehin noch in einem experimentellen Zustand befindet und nicht perfekt ist. Google will seine per KI generierten Inhalte mit einem unsichtbaren Wasserzeichen versehen, welches diese als KI-generiert kennzeichnet.

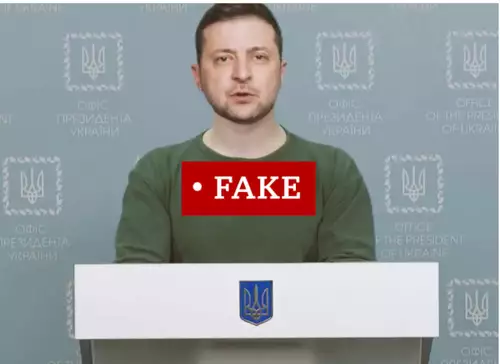

Da allerdings alle dafür notwendigen Techniken bereits bekannt sind und entweder als Forschungsarbeiten oder sogar schon als Open Source Algorithmus vorliegen, wird es der Erfahrung nach nicht lange dauern, bis ein ähnliches Tool, welches all die genannten Schritte in sich vereint, frei veröffentlicht wird. Einzelne DeepFake Videos samt simulierter Stimme sind schon jetzt im Umlauf.