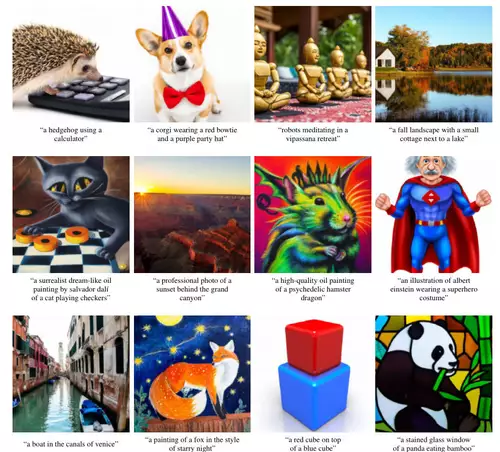

Die neue Folge von "Two Minute Papers" stellt ein sehr interessantes neues DeepLearning Projekt vor, daß gleich auf mehrere Arten für die kreative Arbeit eingesetzt werden kann, denn es ist spezialisiert auf das Generieren hochauflösender photorealistischer Bilder.

Zwar konnte auch schon das auf Transformer-Netzwerk Algorithmen basierende GPT-3 von Open AI, ( hier einige interessante Beispiele für seine Universalität), nicht nur sinnvolle Texte, sondern per Image-GPT auch Bilder generieren, aber diese waren in der Qualität (im Gegensatz zu den Texten) mit einer maximalen Auflösung von 192x192 Pixeln noch ziemlich schlecht.

Die neue Technik, die an der Universität Heidelberg entwickelt wurde, verbessert dagegen gerade die Fähigkeiten des neuronalen Transformer Netzwerks in Bezug auf Bilder durch seine Kombination einem Convolutional Netzwerk (CNN) radikal. Sie ereicht dies, indem Bilder nicht nur als Sequenzen von Pixeln gesehen werden (wie von einem bloßen Transformer Netzwerk), sondern vor dem Training damit erst von einem CNN in visuell sinnvolle (semantische) Bildbestandteile abstrahiert werden, was im Resultat Bilder mit viel höheren Auflösungen möglich macht.

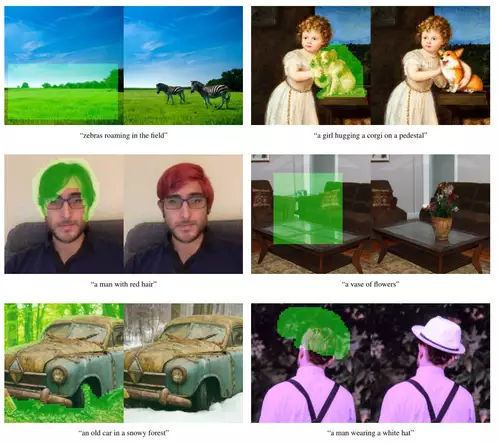

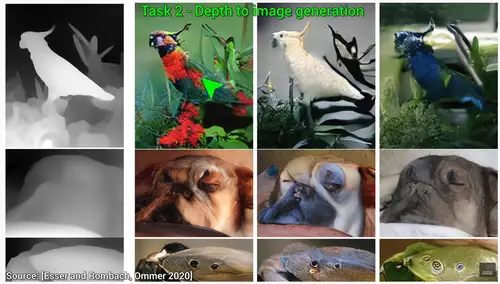

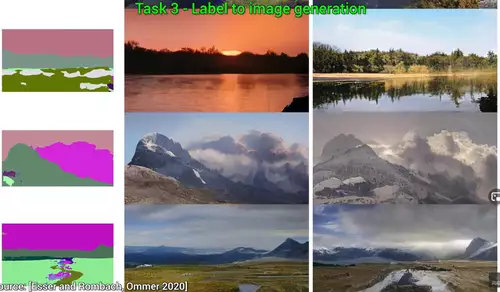

So kann der neue Algorithmus auf Basis des gelernten Bildmaterials sowohl aus einfachen Depth-Maps beliebige passende Bilder und 3D-Objekte erzeugen, als auch aus einer schematischen Skizze (hier Himmel, dort Wasser und Berge) photorealistische Landschaftsaufnahmen generieren, aus unscharfen Bildern per Superresolution detaillierte Versionen zaubern, Photos von Menschen generieren, die eine per Skizze vorgegebene Pose einnehmen oder die abgeschnittene Hälfte von Photos zu ergänzen.

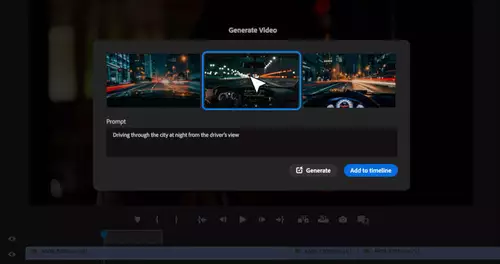

Wie immer dokumentiert Károly Zsolnai-Fehér durch Vergleiche auch die erstaunlich schnelle Entwicklung der verschiedenen KI-Algorithmen - was vor einem Jahr noch mehr schlecht als recht möglich war, ist jetzt schon passabel und ein, zwei Projekte und Weiterentwicklungen später schon nahezu perfekt möglich. Und meist folgen auf KI-Anwendungen für Photos auch Versionen für Videos, die aufgrund der Vielzahl von Bildern und deren zeitlichen Zusammenhang zwar schwieriger zu berechnen sind, aber im Grunde nach den gleichen Prinzipien manipuliert werden können wie Photos.

Wie wir schon in unserem Artikel Schnitt- und Compositing-Trends 2030 - Videoanwendungen im nächsten Jahrzehnt spekuliert hatten, werden in Zukunft durch solche KI-Algorithmen immer intelligentere Arten des (objektbasierten)-Videoeditings möglich.