OpenAI präsentiert nach ChatGPT und Dall-E soeben sein erstes KI-Modell für die Videogenerierung - es nennt sich Sora und erstellt bewegte Bilder auf einem absolut sensationellen Niveau. Die über Textprompts erstellten 46 Clips, die das Unternehmen in FullHD (!) auf seiner Webseite zeigt, weisen eine bisher noch nicht gesehene Konsistenz auf, und selbst Menschen im Bild werden deutlich besser dargestellt als bei konkurrienden Text-zu-Video-Modellen. Auch das räumliche Verständnis des Modells ist beeindruckend. Darüberhinaus kann das Modell laut OpenAI in einem Clip mehrere verschiedene Einstellungen generieren (also Schnittfolgen schaffen) und dabei den Inhalt und visuellen Stil beibehalten.

6. Prompt: A stylish woman walks down a Tokyo street filled with warm glowing neon and animated city signage. She wears a black leather jacket, a long red dress, and black boots, and carries a black purse. She wears sunglasses and red lipstick. She walks confidently and casually. pic.twitter.com/AVM9gvNhC2

Alvaro Cintas (@dr_cintas) February 15, 2024

Introducing Sora, our text-to-video model.

OpenAI (@OpenAI) February 15, 2024

Sora can create videos of up to 60 seconds featuring highly detailed scenes, complex camera motion, and multiple characters with vibrant emotions. https://t.co/7j2JN27M3W

Prompt: Beautiful, snowy pic.twitter.com/ruTEWn87vf

Die von Sora generierten Menschen bewegen sich zwar nicht perfekt, auch sie haben noch etwas zombiehaftes, jedoch gelingen sie sehr viel besser als man es in KI-Clips bisher gesehen hat. Landschaften und Tiere sehen extrem realistisch aus. Auch wenn eine Katze dann plötzlich eine Vordertatze zu viel hat. Sieht man sich die Videos genau an, kann man in fast allen Fehler sowie visuelle Hinweise darauf entdecken, dass sie nicht echt sind - aber man muss teilweise sehr genau hinsehen. Manche Videos wiederum weisen so eklatante Fehldarstellungen auf, dass sie wie ein eigenes verrücktes Videogenre wirken.

OpenAIs new Text to video model Sora just announced pic.twitter.com/fvhcwxc6qb

AI Breakfast (@AiBreakfast) February 15, 2024

7. Prompt: Drone view of waves crashing against the rugged cliffs along Big Surs garay point beach. The crashing blue waters create white-tipped waves, while the golden light of the setting sun illuminates the rocky shore. A small island with a lighthouse sits in the distance, pic.twitter.com/G5eOUeCwHH

Alvaro Cintas (@dr_cintas) February 15, 2024

even the sora mistakes are mesmerizing pic.twitter.com/OvPSbaa0L9

— Charlie Holtz (@charliebholtz) February 15, 2024

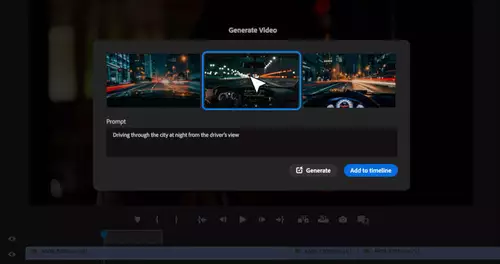

Wie Dall-E aus dem gleichen Hause ist auch Sora ein Diffusionsmodell. Dank der integration mit OpenAIs Sprachmodell ChatGPT ist Sora in der Lage, sehr detaillierte Prompts zu interpretieren und in komplexe Szenen umzusetzen. Zu jedem gezeigten Video gibt OpenAI auch das entsprechende Prompt an - darin finden sich nicht nur ausführliche Beschreibungen der gewünschten Szenerien, sondern auch Anweisungen zur Kamerabewegung. Beispielsweise:

- "The scene is captured from a wide angle, showing the vastness and depth of the ocean. The water is clear and blue, with rays of sunlight filtering through. The shot is sharp and crisp, with a high dynamic range. The octopus and the crab are in focus, while the background is slightly blurred, creating a depth of field effect." Clip

- "The camera follows behind a white vintage SUV with a black roof rack as it speeds up a steep dirt road surrounded by pine trees on a steep mountain slope, dust kicks up from its tires, the sunlight shines on the SUV as it speeds along the dirt road, casting a warm glow over the scene." Clip

Richtig spannend sind auch die Fähigkeiten Soras, "historisches" Material herbeizuzaubern, beispielsweise Bilder aus Kalifornien während des Goldrausches.

10. Prompt: Historical footage of California during the gold rush. pic.twitter.com/APqzjHfcz9

Alvaro Cintas (@dr_cintas) February 15, 2024

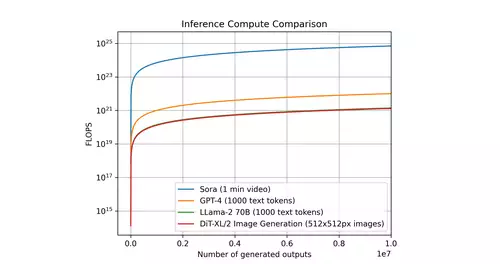

Videoclips lassen sich mit einer Länge von bis zu einer Minute erstellen. Auch ein Referenzbild lässt sich als Ausgangsmaterial nehmen. Ebenso kann Sora einen bestehenden Clip erweitern/verlängern oder fehlende Frames ergänzen. Die Videos werden allerdings ohne Ton generiert.

T-Minus 10 seconds until the Hollywood doomer threads begin circulating. https://t.co/3KYmxVMkO9 pic.twitter.com/v54tJtdug1

fofr (@fofrAI) February 15, 2024

10. Pup pic.twitter.com/ihlxoPBzzS

— Min Choi (@minchoi) February 15, 2024

Sora ist noch nicht frei zugänglich - tatsächlich ist es laut OpenAI gar nicht sicher, dass das Modell jemals als Produkt angeboten werden soll. Wenn ja, sollen C2PA-Metadaten eingebettet werden, um die Videos als KI-generiert erkennbar zu machen.

Zunächst soll Sora jedoch ausgiebig in der Praxis getestet werden, um (so OpenAI) mögliche Risiken auszuloten bzw. robuste Filter zu impementieren. Doch auch einige ausgewählte Künstler, Designer und Filmemacher erhalten Zugang, um zu evaluieren, wie Sora in der Kreativ-Szene genutzt werden kann.

welcome to bling zoo! this is a single video generated by sora, shot changes and all. https://t.co/81ZhYX4gru pic.twitter.com/rnxWXY71Gr

— Bill Peebles (@billpeeb) February 15, 2024