Seit kurzem werden Videos im Internet gepostet, welche mit einer - mutmaßlich - neuen Funktion im KI-Videogenerator Runway Gen2 erstellt wurden. Im Juni wurde ja die zweite Generation des Modells öffentlich zugänglich - eine Image-2-Video Funktion war mitangekündigt, sie erstellt soweit wir wissen jedoch bewegte Variationen auf das gezeigte Motiv. Wie es scheint hat die Community nun eine neue Art entdeckt, Clips aus Einzelbildern zu gewinnen.

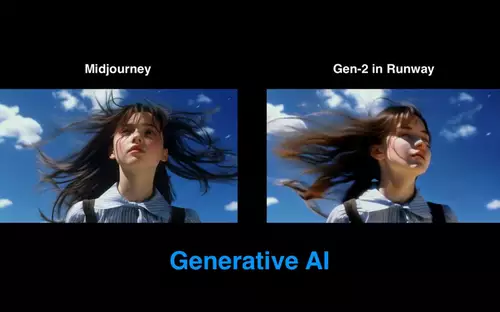

Das besondere an diesen neuen Animationen ist, dass sie wie es scheint ganz ohne Prompt generiert wurden. Es wird einfach ein einzelnes Bild eingegeben, etwa eines aus einem KI-Bildgenerator wie Midjourney oder Stable Diffusion, und Runway Gen2 erkennt selbständig, welche Bildteile sich sinnvoll bewegen könnten. Dies setzt einiges an Objekterkennung und -einordnung voraus, etwa "weiß" Runway, dass Menschen ihre Köpfe drehen, oder Arme bewegen, dass Haare im Wind wehen und ähnliches. Doch auch der Kameraausschnitt wandert.

Auf diese Weise lassen sich einzelne Bilder zu kurzen Clips animieren, jeweils maximal 4 Sekunden (im Basis-Account). Dies funktioniert mit Zeichnungen ebenso wie mit fotorealistischen Aufnahmen, allerdings sicherlich nicht immer und gleich gut. Je komplexer der Bildaufbau, umso seltsamer das Resultat; menschliche Bewegungsabläufe gelingen (noch) nicht überzeugend. Einen Zombiefilm könnte man so wohl am ehesten generieren.

Das 4-Sekunden-Limit läßt sich theoretisch umgehen, indem das letzte Frame einer animierten Sequenz wieder als Startbild für die nächste Animation eingegeben wird, allerdings bleibt man vermutlich inhaltlich in einem Loop gefangen. Mangels Prompt hat man keinerlei Kontrolle über die Animation. Doch wie jede neue Spielerei lässt sich bestimmt auch diese irgendwie kreativ nutzen.

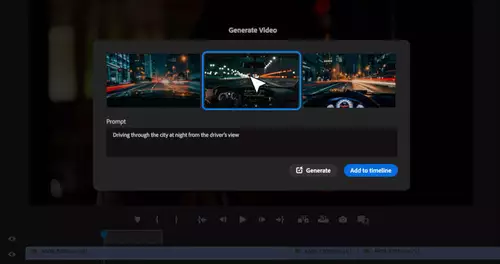

Folgendes Video zeigt, wie einfach sich solche Animationen erstellen lassen.