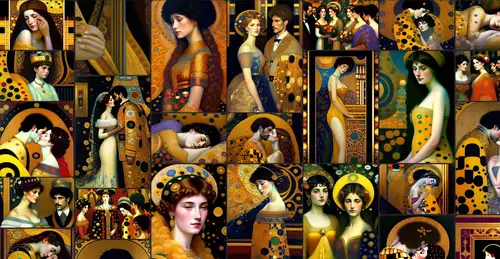

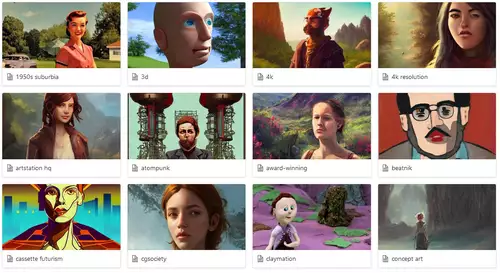

KI-Bildgeneratoren wie DALL-E oder Stable Diffusion können auf Textkommando digitale Bilder errechnen, die teilweise kaum mehr von echten Fotos zu unterscheiden sind, oder die - zumindest bei flüchtiger Betrachtung - wie Abbildungen von gemalten Kunstwerken aussehen. Bei frühen Versionen der Generatoren war es sogar vielfach möglich, per Prompt Stile von bestimmten, berühmten Künstlern oder Fotografen vorzugeben, mit anderen Worten zu kopieren.

In der Künstlerszene sorgte dies für große Empörung - nicht nur wurden kopiergeschützte Bildwerke ungefragt zum Trainieren der KI-Generatoren verwendet, sondern diese ermöglichen es nun, auf Knopfdruck Bilder zu erstellen, die denen der ursprünglichen Künstlern Konkurrenz machen.

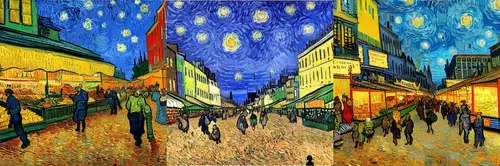

Als Reaktion wurden teilweise die Promptmöglichkeiten eingeschränkt und für manche der KI-Generatoren Opt-out-Möglichkeiten implementiert, über die Künstler der Nutzung ihrer Bilder zu Trainigszwecken widersprechen können (allerdings scheint unklar, in wie weit darauf Verlass ist, dass dem auch Folge geleistet wird). Dies geht jenen, die selbst die Kontrolle über ihre Werke behalten möchten, jedoch nicht weit genug; einen ganz anderen Ansatz verfolgt daher das Tool Glaze, mit welchem sich - für Menschen nahezu unmerklich - ins Netz gestellte Bilder so manipulieren lassen, dass sie für das Training von Bild-KIs "unverdaulich" werden. Die KI ist daraufhin nicht in der Lage, den Stil dieser Bilder zu reproduzieren.

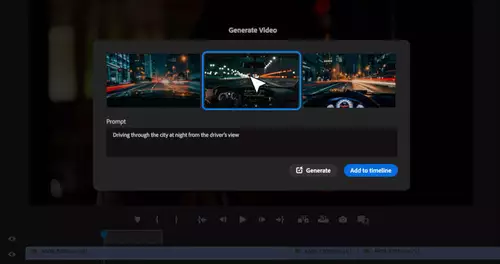

Glaze wurde von Informatikern der Universität Chicago entwickelt, und das gleiche Team von Ben Zhao geht mit einem neuen Tool names Nightshade nun noch einen Schritt weiter. Denn mit Nightshade sollen sich Trainigsdatensätze geradezu "vergiften" lassen, indem die Bilder wie bei Glaze auf Pixelebene subtil verändert werden, allerdings in diesem Fall so, dass zwischen dem Bild und seinen Metatags (seiner Beschreibung in Worten) ein Riß entsteht - dies stellt eine "Prompt-Specific Poisoning Attack" dar. Diese Änderungen sollen (anders als bei Glaze) einem Diffusionsmodell, das unerlaubt mit solchen Bildern trainiert wird, richtig Schaden zufügen.

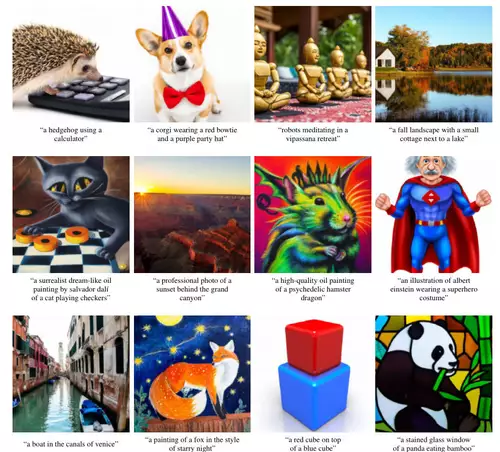

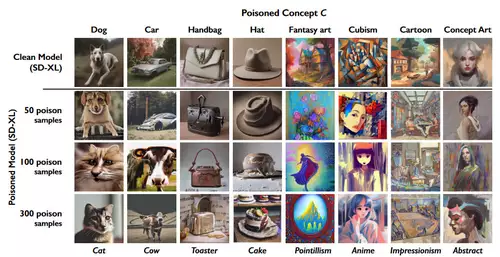

Da die Text-zu-Bild-Generatoren Verbindungen lernen zwischen Bildinhalten und ihren Bezeichnungen, komme das Modell durcheinander, wenn genug von Nightshade manipulierte Bilder im Lernkorpus enthalten sind. Laut der kürzlich veröffentlichten Studie, welche nun für Peer Review offen ist, soll ein Modell dann nicht mehr in der Lage sein, manchen Textprompts korrekt zu folgen. Statt einem Hund wird im Extremfall dann plötzlich eine Katze dargestellt, statt einem Auto eine Kuh, eine Handtasche wird zum Toaster - das Verhalten wird durch die verunreinigten Daten chaotisch und unvorhersehbar.

Nightshade stellt somit eine Art drastischen Kopierschutz dar und wurde entwickelt, um Künstlern Macht über ihre Werke zurückzugeben - KI-Unternehmen sollen abgeschreckt werden, Bilder ohne Erlaubnis zu verwenden. Gleichzeitig kann das Tool natürlich auch mißbraucht und mutwillig zur Sabotage eingesetzt werden; genutzt wird ohnehin eine inhärente Schwachstelle der KI-Modelle, welche ja von der Qualität ihrer Trainigsdaten abhängig sind. Sind diese - meist auf großer Skala von Bots im Internet eingesammelten - Daten fehlerhaft oder vergiftet, reproduziert das Modell diese Fehler bei seinen Ausgaben.

Nightshade soll als Funktion im bereits verfügbaren Tool Glaze integriert werden, auch soll eine Open Source Version veröffentlicht werden. Die komplette Studie läßt sich hier einsehen.